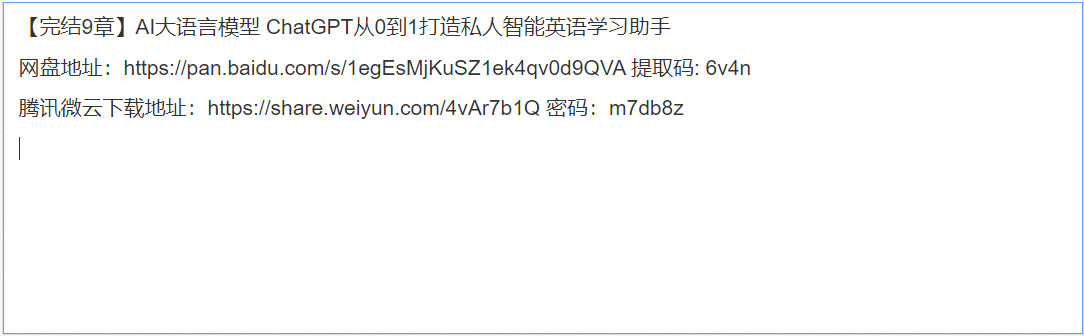

【完结9章】AI大语言模型 ChatGPT从0到1打造私人智能英语学习助手

视频课程分享——AI大语言模型 ChatGPT从0到1打造私人智能英语学习助手,完结19章。附源码下载。

深度学习的子领域中有两个重要的概念:大型语言模型(LLMs)和生成式人工智能(Generative AI)。大型语言模型,这类模型预先通过大量的文本数据进行训练,通常是从互联网或其他公开可获取的书籍中提取的。预训练期间,模型学习并理解文本数据的模式和结构。之后,在微调阶段,模型会根据特定的任务进行优化,这些任务可能包括机器翻译、文本生成、情感分析等。

与OrderStateEnum一样,我们来声明另一个枚举类型,状态触发类型

public enum OrderStateTriggerEnum

{

PlaceOrder, // 支付

Approve, // 收款成功

Reject, // 收款失败

Cancel, // 取消

Return // 退货

}

首先,我们通过在IPropertyMapping列表中传入的数据源类型到目标类型的propertyMappings,来找到匹配的映射对象。

// get matching mapping

var matchingMapping = propertyMappings.OfType<PropertyMapping<TSource, TDestination>>();

如果能找到,那么就返回匹配结果的字典,

if (matchingMapping.Count() == 1)

{

return matchingMapping.First()._mappingDictionary;

}

否则,抛出异常

throw new Exception($"找不到属性映射实例<{typeof(TSource)},{typeof(TDestination)}");

全部链接添加完毕,我们就要可以返回响应了,响应数据就是links列表。现在,用户就可以通过访问这个api的根目录获得api的使用方法了。

[Route("api")]

[ApiController]

public class RootController: ControllerBase

{

[HttpGet(Name = "GetRoot")]

public IActionResult GetRoot()

{

var links = new List<LinkDto>();

// 自我链接

links.Add(

new LinkDto(

Url.Link("GetRoot", null),

"self",

"GET"

));

// 一级链接 旅游路线 “GET api/touristRoutes”

links.Add(

new LinkDto(

Url.Link("GetTouristRoutes", null),

"get_tourist_routes",

"GET"

));

// 一级链接 旅游路线 “POST api/touristRoutes”

links.Add(

new LinkDto(

Url.Link("CreateTouristRoute", null),

"create_tourist_route",

"POST"

));

// 一级链接 购物车 “GET api/orders”

links.Add(

new LinkDto(

Url.Link("GetShoppingCart", null),

"get_shopping_cart",

"GET"

));

// 一级链接 订单 “GET api/shoppingCart”

links.Add(

new LinkDto(

Url.Link("GetOrders", null),

"get_orders",

"GET"

));

return Ok(links);

}

}

GPT是基于Transformer架构的大语言模型,近年迭代演进迅速。 构建语言模型是自然语言处理中最基本和最重要的任务之一。GPT是基于Transformer架构衍生出的生成式预训练的单向语言模型,通过对大 量语料数据进行无监督学习,从而实现文本生成的目的;在结构上仅采用Transformer架构的Decoder部分。自2018年6月OpenAI发布GPT-1模 型以来,GPT模型迭代演进迅速。GPT-1核心思想是采用“预训练+微调”的半监督学习方法,服务于单序列文本的生成式任务;GPT-2在预训 练阶段引入多任务学习机制,将多样化的自然语言处理任务全部转化为语言模型问题;GPT-3大幅增加了模型参数,更能有效利用上下文信息, 性能得到跨越式提高;GPT-3.5引入人类反馈强化学习机制,通过使用人类反馈的数据集进行监督学习,能够使得模型输出与人类意图一致。

GPT(Generative Pre-training Transformer)是生成式预训练的单向语言模型。通过对大量语料数据进行无 监督学习,从而实现文本生成的目的。结构上,GPT仅采用Transformer架构的Decoder部分。 自2018年6月起OpenAI发布GPT-1模型以来,GPT更新换代持续提升模型及参数规模。随着OpenAI于2022年11月30 日发布ChatGPT引爆AI领域,海内外科技公司纷纷宣布发布大语言模型。用户爆发式增长对大语言模型的算力需求带 来挑战。

这是一个创建于 的文章,其中的信息可能已经有所发展或是发生改变。

- 请尽量让自己的回复能够对别人有帮助

- 支持 Markdown 格式, **粗体**、~~删除线~~、

`单行代码` - 支持 @ 本站用户;支持表情(输入 : 提示),见 Emoji cheat sheet

- 图片支持拖拽、截图粘贴等方式上传